Allucinazioni dell’IA: perché usiamo una parola così umana per gli errori delle macchine

04/05/2026

Ci sono errori che si chiamano semplicemente errori. Poi ci sono quelli dell’intelligenza artificiale, che abbiamo cominciato a chiamare allucinazioni. La differenza non è piccola: la parola porta subito la macchina in un territorio umano, quasi inquietante, fatto di percezione, mente, realtà distorta. Ed è proprio per questo che colpisce.

Nel lessico dell’IA, un’allucinazione non è una visione nel senso umano del termine. È una risposta plausibile, fluida, a volte persino convincente, ma falsa o inventata. OpenAI definisce le allucinazioni dei modelli linguistici come affermazioni plausibili ma false; Google Cloud parla di risultati errati o fuorvianti generati dai modelli di intelligenza artificiale. Il punto non è soltanto che la risposta sia sbagliata. Il punto è che spesso sembra giusta.

È qui che la parola mostra tutta la sua forza. Dire “errore” sarebbe più neutro, più tecnico, forse anche più rassicurante. Dire allucinazione, invece, cambia la scena: non descrive un guasto evidente, ma un’apparizione credibile che non corrisponde alla realtà. Nel linguaggio comune, l’allucinazione è qualcosa che viene percepito come reale pur non essendolo. Trasferita all’IA, questa idea diventa una metafora potente: il modello produce una realtà verbale che sta in piedi nella forma, ma non nei fatti.

La metafora, però, va maneggiata con attenzione. Un modello linguistico non “vede”, non “sente”, non ha percezioni alterate, non possiede un’esperienza interiore. Non scambia immagini mentali per realtà, perché non ha una mente nel senso umano. Anche OpenAI, nel suo lavoro sulle allucinazioni dei modelli linguistici, precisa che questo uso del termine è diverso dall’esperienza percettiva umana. Dunque la parola funziona perché rende l’idea, non perché descriva alla lettera ciò che accade dentro la macchina.

Perché allora si è imposta proprio questa parola? Perché dice molto bene una caratteristica tipica dell’IA generativa: la capacità di produrre frasi ben formate anche quando manca un appoggio sicuro ai fatti. I modelli linguistici non ragionano come un archivio ordinato che recupera sempre una verità già verificata. Generano testo calcolando quali parole, o più precisamente quali parti di parola, siano probabili in un certo contesto. Se il sistema non ha un ancoraggio sufficiente a dati affidabili, può costruire una risposta elegante, coerente e... completamente sbagliata.

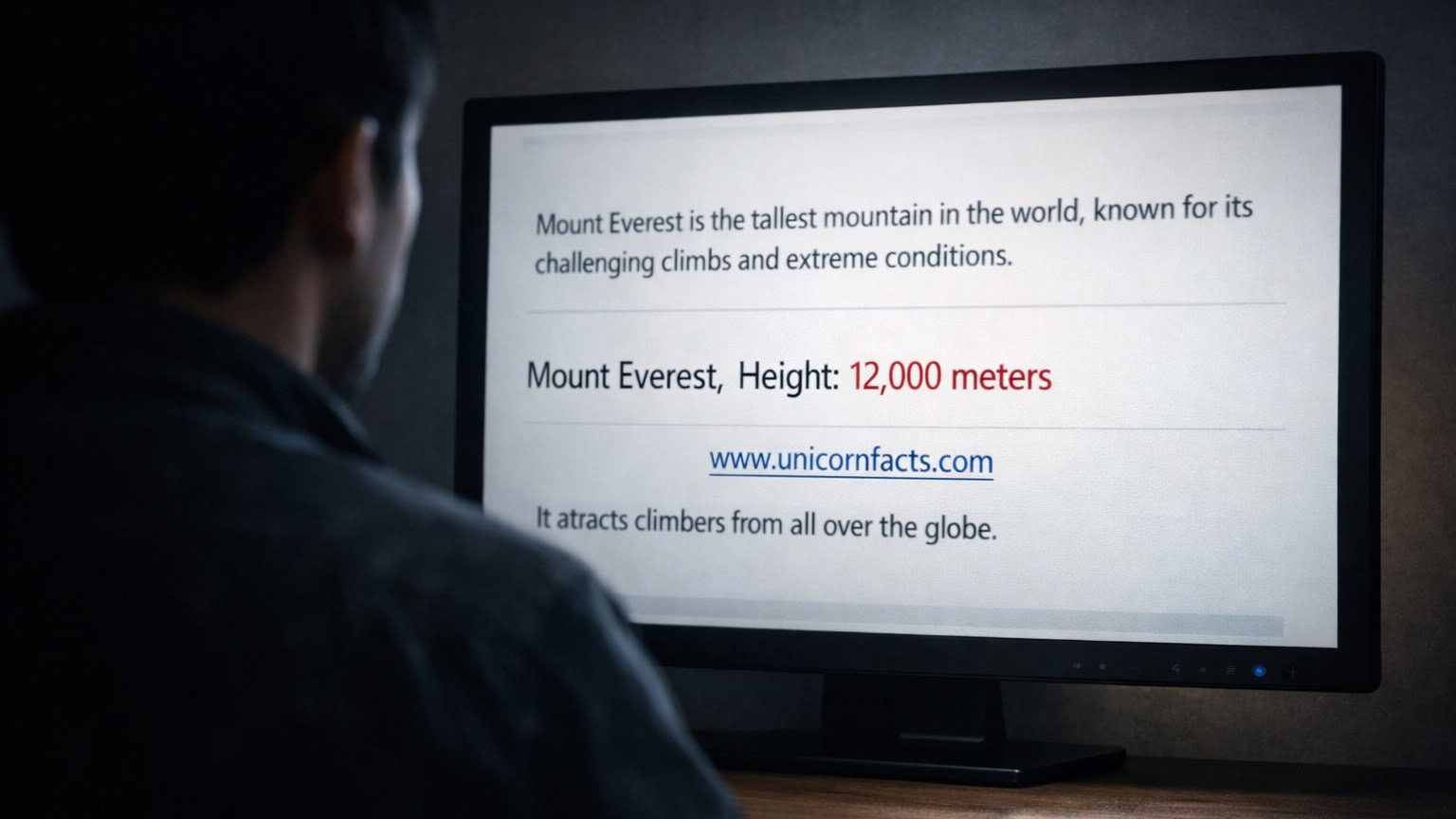

Per il lettore, questo è l’aspetto più insidioso. L’allucinazione dell’IA raramente si presenta come un errore grossolano e subito riconoscibile. Può assumere la forma di una citazione inesistente, di un link inventato, di una data sbagliata, di una spiegazione molto ordinata ma priva di fondamento. La documentazione di Google su Gemini cita proprio output plausibili ma fattualmente scorretti e persino collegamenti a pagine che non esistono. La falsità, in questi casi, non arriva vestita da falsità. Arriva vestita da risposta autorevole.

Anche linguisticamente la differenza è importante. Errore indica il risultato: qualcosa non torna. Allucinazione indica anche il modo in cui quel risultato si presenta: qualcosa di non vero appare come se fosse vero. La parola non racconta soltanto l’inesattezza del contenuto, ma la sua capacità di convincere. È per questo che si è rivelata così efficace nel discorso pubblico sull’intelligenza artificiale.

Negli ultimi anni, proprio per limitare questo problema, si è parlato sempre più spesso di grounding, cioè di collegamento delle risposte a fonti, documenti o dati verificabili. Google descrive il grounding come un modo per connettere l’output dei modelli a fonti controllabili e ridurre le allucinazioni. Anche qui il lessico è interessante: da una parte c’è l’allucinazione, immagine di qualcosa che fluttua senza fondamento; dall’altra c’è il “radicamento”, l’ancoraggio a una realtà esterna. La lingua tecnica, quando funziona, costruisce quasi una piccola scena.

Il successo della parola allucinazione dipende anche da un paradosso: umanizza il difetto della macchina proprio mentre prova a spiegarlo. Appena la usiamo, l’IA sembra meno un programma che sbaglia e più un’entità che immagina, inventa, quasi crede a ciò che dice. Ma questa impressione è ingannevole. Non siamo davanti a un delirio, a una visione o a una coscienza confusa. Siamo davanti a un sistema capace di generare linguaggio convincente senza garantire, da solo, che quel linguaggio sia vero.

Per questo la parola è utile, ma non innocente. Illumina un aspetto decisivo dell’IA generativa: la distanza possibile tra forma e verità. Allo stesso tempo, rischia di farci attribuire alla macchina qualità che non possiede. Come molte metafore riuscite, chiarisce e deforma insieme. Ci aiuta a capire, ma ci invita anche a restare prudenti.

Forse è proprio per questa tensione che allucinazione ha attecchito così bene. È una parola tecnica, ma si capisce subito. È nuova nel campo dell’intelligenza artificiale, ma sembra antica. E soprattutto racconta una paura molto contemporanea: quella di non riuscire più a distinguere, a colpo d’occhio, una risposta corretta da una risposta soltanto credibile.

Categorie dell'articolo:

Parole dell’Intelligenza ArtificialeAltri articoli in Parole dell’Intelligenza Artificiale:

Antropocentrico: la parola difficile che vuole rimettere l’uomo al centro dell’IA Dal significato greco di “uomo al centro” al suo uso nelle norme sull’intelligenza artificiale: una parola tecnica che oggi serve a discutere diritti, responsabilità e rapporto tra persone e tecnologia.

Antropocentrico: la parola difficile che vuole rimettere l’uomo al centro dell’IA Dal significato greco di “uomo al centro” al suo uso nelle norme sull’intelligenza artificiale: una parola tecnica che oggi serve a discutere diritti, responsabilità e rapporto tra persone e tecnologia. Agentico: il termine nuovo che racconta un’IA più attiva e meno passiva Agentico è il termine che sta emergendo nel lessico dell’IA per descrivere sistemi che non si limitano a rispondere, ma organizzano azioni, usano strumenti e portano avanti compiti in più fasi. Una parola nuova e ancora instabile, ma già molto rivelatrice del modo in cui oggi raccontiamo l’intelligenza artificiale.

Agentico: il termine nuovo che racconta un’IA più attiva e meno passiva Agentico è il termine che sta emergendo nel lessico dell’IA per descrivere sistemi che non si limitano a rispondere, ma organizzano azioni, usano strumenti e portano avanti compiti in più fasi. Una parola nuova e ancora instabile, ma già molto rivelatrice del modo in cui oggi raccontiamo l’intelligenza artificiale.| Dizy © 2013 - 2026 Prometheo | Informativa Privacy - Avvertenze |